//

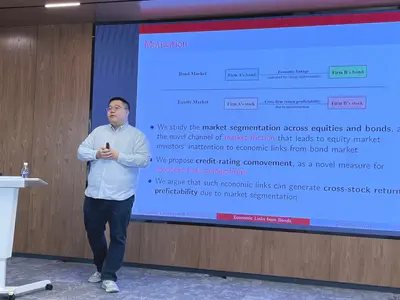

1月13日,2023 ZIBS学术论坛于国际校区多功能厅举行。本次活动以“革新未来:商业卓越的前瞻之路”为主题,围绕数据智能、环境科学、金融科技、数字创新、企业革新等问题,分享商业发展前沿阵地的最新研究成果、创新发现和实践经验,为全球商业、科技和教育领域的可持续发展贡献独到的见解。

在分论坛下午场的“青年学者论坛”环节,ZIBS海纳研究员李超发表了“带有缺失信息的多元时序数据通用预训练模型”的主题演讲,提出一种基于预训练的模型,专注于处理带有缺失信息的多元时序数据。以下为其演讲观点摘要。

01

背景与动因

李超及其团队主要研究多元时间序列这一工业领域最常见的数据形式。他表示,这类数据可用于预测、分类和故障检测等,以便更好地分析系统的状态。

完整的数据集对这类研究而言非常重要。然而,在实际的系统中,传感器在收集数据到将数据传输到云平台的过程中不可避免的会出现数据缺失的问题。(如下图左边部分所示)。例如单一传感器故障会发生单变量缺失,当工业网络中RTU发生故障会出现线状缺失,而当主控发生故障时会发生块状缺失。以上都是工业时序数据中常见的缺失模式,如果不经合理处理,从而缺少完整数据集,很多时序分析方法会失效或效果显著下降,进而极大降低数据分析能力。

那么,当这种情况发生时,该怎么解决?解决方法一般为如下两个阶段:

1

缺失数据插补;

2

下游任务训练。

因此,当你进行缺失的插补时,需要将不完整的数据插补到一个完整的数据集,然后要训练这些数据以用于不同的下游任务。

然而在实际研究中,研究团队发现了如下问题:

1

数据插补过程不可避免会在缺失位置进行有偏填充;

2

数据填充与下游任务都会进行特征学习,造成训练冗余(预测、分类、异常检测等);

3

MTS数据中的棘手缺失模式(线丢失/块丢失)。

首先,任何现有的数据缺失插补模型都不可避免地会引起有偏估计现象;其次,传统的“缺失数据插补+下游任务训练”的训练框架会带来训练冗余问题,因为在缺失值插补与下游任务训练中同时都存在特征提取过程。最后,即使使用传统训练框架,目前针对MTS数据中有棘手的缺失模式,例如线缺失、块缺失等,尚未有优秀的缺失值插补方法。

基于上述问题,研究团队提出了其面向多元时序缺失数据的通用预训练流程。

02

TriD MAE主要贡献

它是第一个通用MTS缺失数据表示学习框架,可以作为其他专门下游模型的前置模块;

DPE机制在理论上管理了所有缺失模式,从而彻底避免了上述有偏填充问题;

作为基本单元的TriD TCN结构能够生成可迁移编码嵌入,从而快速促进下游任务收敛。

03

问题陈述

研究团队使用掩码自编码器结构来完成这项工作。模型采用“多元时序矩阵X“与表征缺失的“二进制矩阵M”作为输入,通过编码器将这个X投影到一个隐藏表征H中,并通过解码器重建它,使H尽可能多地覆盖完整数据信息。

04

模型体系结构

研究团队的研究主要介绍了几种特殊的设计架构。

1

膨胀因果卷积网络(DCCN),利用不断增大的多个膨胀核,提取和集成局部和全局序列信息;

2

TriD-TCN基础单元,它可以处理高维多元长时间序列;

3

TriD-TCN模块:赋予原始TCN结构以双向动态的特征提取能力,使其可以自适应、多尺度处理高维多元长时间序列;

4

动态位置嵌入(DPE):提出一种全新的缺失位置表示方法,通过将时变与变量间相关性结合的方式,充分表达不同缺失位置的信息;

5

掩码自编码训练:采用人为掩码方式训练,并设计特异性损失函数,充分评估掩模部分与所有观测部分的重建误差,使得编码器与DPE机制充分训练。

05

实验过程

研究团队已经在UCI机器学习库中的家电能源预测数据、北京多站点数据、空气质量数据和SML2010等公共数据集上对该模型进行了测试。

通过与DARNN64、TPA-RNN64、Transformer128、Informer128和Autoformer128等在时间序列上表现较好的下游模型的比较,以及与多重插补、BRITS和E2GAN等传统的缺失填补方法的比较,研究团队的方法得到了有效验证。其团队研究测试了缺失率从10%上升到80%的不同情况,当缺失率很低时,TriD MAE与传统的序列模型性能相同,但具有更快的下游任务收敛能力;当缺失率增加到80%时,TriD MAE在快速下游任务收敛的基础上,同时具备更佳的性能表现。

此外,还与传统流程进行了其他一些比较,将TriD-MAE作为这些下游模型的前置,下游模型与传统流程中的模型共享相同的超参数,其中一些复杂的下游模型涉及微调阶段,以验证所提议框架的“极限性能”。

06

总结

李超总结了TriD MAE的以下三点贡献:

1

它是第一个通用MTS缺失数据表示学习框架,可以作为其他专门下游模型的前置模块;

2

研究提出的DPE机制在理论上管理了所有缺失的模式,从而彻底避免了上述有偏插补问题;

3

研究所提出的作为基本单元的TriD TCN结构能够生成可转移编码嵌入,从而快速促进下游任务收敛。

李超表示,其团队未来工作将扩展到时空数据场景,并加强处理长序列的能力。

*以上内容由李超在ZIBS 2023ZIBS学术论坛上的演讲发言整理而成。文章仅代表学者个人观点,不代表ZIBS立场。

李超

海纳研究员

李超博士现任ZIBS海纳研究员。本科毕业于浙江大学竺可桢学院、获工学学士,博士毕业于浙江大学控制科学与工程学院,师从孙优贤院士、陈积明教授,获工学博士。研究领域是数据科学及其在智慧城市、工业智能等领域的应用,主要与行业头部企业(国网、阿里、临工、运达风电、每日互动等)合作,基于实际场景的真实数据进行数据智能研究。研究成果发表在IEEE TITS,TMC,TCSS,National Science Open,Communications Physics等国际顶级学术期刊上。

2024.07.04

2024.07.03

2024.06.30

2024.06.26

2024.06.25

2024.06.17

2024.06.15

2024.06.12

2024.06.11

2024.06.08

2024.06.06

2024.06.05

2024.06.04

2024.06.01

2024.05.31

2024.05.30

2024.05.29

2024.05.29

2024.05.27

2024.05.23

2024.05.22

2024.05.21

2024.05.15

2024.05.13

2024.05.13

2024.05.13

2024.05.11

2024.05.10

2024.05.09

2024.05.07

2024.05.07

2024.05.06

2024.05.06

2024.05.02

2024.05.02

2024.05.01

2024.05.01

2024.04.30

2024.04.29

2024.04.27

2024.04.25

2024.04.24

2024.04.23

2024.04.22

2024.04.18

2024.04.17

2024.04.15

2024.04.14

2024.04.11

2024.04.08

2024.04.08

2024.04.07

2024.04.04

2024.04.03

2024.04.02

2024.04.01

2024.03.30

2024.03.28

2024.03.26

2024.03.24

2024.03.23

2024.03.21

2024.03.15

2024.03.08

2024.03.05

2024.03.01

2024.02.27

2024.02.23

2024.02.21

2024.02.19

2024.02.15

2024.02.13

2024.02.11

2024.02.10

2024.02.09

2024.02.07

2024.02.07

2024.02.06

2024.02.05

2024.02.02

2024.01.31

2024.01.30

2024.01.30

2024.01.29

2024.01.29

2024.01.27

2024.01.25

2024.01.24

2024.01.22

2024.01.16

2024.01.15

2024.01.14

2024.01.13

2024.01.12

2024.01.10

2024.01.04

2023.12.29

2023.12.29

2023.12.28

2023.12.27

2023.12.26

2023.12.25

2023.12.22

2023.12.22

2023.12.21

2023.12.20

2023.12.15

2023.12.15

2023.12.13

2023.12.12

2023.12.12

2023.12.11

2023.12.08

2023.12.08

2023.12.07

2023.12.07

2023.12.06

2023.12.05

2023.12.04

2023.12.04

2023.12.04

2023.12.03

2023.12.02

2023.11.30

2023.11.30

2023.11.29

2023.11.29

2023.11.28

2023.11.27

2023.11.25

2023.11.24

2023.11.24

2023.11.23

2023.11.23

2023.11.22

2023.11.21

2023.11.21

2023.11.17

2023.11.15

2023.11.14

2023.11.13

2023.11.12

2023.11.12

2023.11.11

2023.11.10

2023.11.10

2023.11.09

2023.11.08

2023.11.07

2023.11.06

2023.11.05

2023.11.03

2023.11.02

2023.10.30

2023.10.28

2023.10.28

2023.10.27

2023.10.26

2023.10.24

2023.10.20

2023.10.19

2023.10.18

2023.10.17

2023.10.16

2023.10.15

2023.10.12

2023.10.11

2023.10.10

2023.10.09

2023.10.08

2023.10.08

2023.10.06

2023.10.05

2023.10.04

2023.10.02

2023.09.30

2023.09.30

2023.09.28

2023.09.27

2023.09.26

2023.09.22

2023.09.21

2023.09.20

2023.09.15

2023.09.13

2023.09.11

2023.09.09

2023.09.08

2023.09.07

2023.09.07

2023.08.31

2023.08.30

2023.08.30

2023.08.29

2023.08.28

2023.08.21

2023.08.18

2023.08.17

2023.08.16

2023.08.15

2023.08.14

2023.08.09

2023.08.09

2023.08.08

2023.08.04

2023.08.04

2023.07.31

2023.07.28

2023.07.27

2023.07.24

2023.07.24

2023.07.23

2023.07.21

2023.07.20

2023.07.20

2023.07.19

.jpg?imageView2/1/w/400/h/300/format/webp)

2023.07.18

2023.07.17

2023.07.17

2023.07.14

2023.07.13

2023.07.11

2023.07.07

2023.07.06

2023.07.05

2023.06.30

2023.06.29

2023.06.28

2023.06.27

2023.06.26

2023.06.23

2023.06.22

2023.06.19

2023.06.17

2023.06.16

2023.06.15

2023.06.14

2023.06.14

2023.06.13

2023.06.13

2023.06.11

2023.06.09

2023.06.08

2023.06.08

2023.06.07

2023.06.07

2023.06.06

2023.06.05

2023.06.02

2023.05.31

2023.05.30

2023.05.30

2023.05.30

2023.05.30

2023.05.26

2023.05.25

2023.05.23

2023.05.21

2023.05.18

2023.05.17

2023.05.16

2023.05.15

2023.05.14

2023.05.11

2023.05.11

2023.05.09

2023.05.08

2023.05.06

2023.05.02

2023.04.28

2023.04.27

2023.04.27

2023.04.26

2023.04.24

2023.04.24

2023.04.20

2023.04.20

2023.04.19

2023.04.19

2023.04.17

2023.04.16

2023.04.13

2023.04.11

2023.04.11

.jpg?imageView2/1/w/400/h/300/format/webp)

2023.04.07

2023.04.07

.jpg?imageView2/1/w/400/h/300/format/webp)

2023.04.06

.jpg?imageView2/1/w/400/h/300/format/webp)

2023.04.05

2023.04.05

2023.04.03

2023.04.03

2023.04.01

2023.03.30

2023.03.30

2023.03.28

2023.03.28

2023.03.27

2023.03.24

2023.03.23

2023.03.22

2023.03.21

2023.03.21

2023.03.20

2023.03.20

2023.03.17

2023.03.14

2023.03.13

2023.03.13

2023.03.12

2023.03.10

2023.03.10

2023.03.09

2023.03.09

2023.03.05

2023.02.28

2023.02.27

2023.02.24

2023.02.24

2023.02.23

2023.02.21

2023.02.20

2023.02.19

2023.02.18

2023.02.18

2023.02.17

2023.02.16

2023.02.15

2023.02.15

2023.02.10

2023.02.02

2023.01.31

2023.01.23

2023.01.23

2023.01.22

2023.01.20

2023.01.19

2023.01.19

2023.01.18

2023.01.17

2023.01.17

2023.01.15

2023.01.12

2023.01.06

2023.01.06

2023.01.04

2022.12.26

2022.12.23

2022.12.20

2022.12.20

2022.12.18

2022.12.17

2022.12.17

2022.12.16

2022.12.15

2022.12.10

2022.12.10

2022.12.09

2022.12.08

2022.12.05

2022.12.04

2022.12.02

2022.12.01

2022.11.25

2022.11.25

2022.11.24

2022.11.23

2022.11.22

.jpg?imageView2/1/w/400/h/300/format/webp)

2022.11.22

2022.11.19

2022.11.18

2022.11.17

2022.11.15

2022.11.12

2022.11.11

2022.11.10

2022.11.10

2022.11.05

2022.11.03

2022.11.02

2022.11.01

2022.10.26

2022.10.25

2022.10.19

2022.10.19

.jpg?imageView2/1/w/400/h/300/format/webp)

2022.08.09

.jpg?imageView2/1/w/400/h/300/format/webp)

2022.08.07

2022.08.04

2022.08.04

2022.08.04

2022.08.04

2022.07.26

2022.07.22

2022.07.20

2022.07.15

2022.07.08

2022.07.07

2022.07.06

2022.06.24

2022.06.20

.jpg?imageView2/1/w/400/h/300/format/webp)

2019.05.07